به اشتراک بگذارید

به اشتراک بگذارید

حتماً زمانی که این مقاله را باز کردهاید، یا با مشکل کندی عجیب سایت مواجه شدهاید که ردپای ربات گوگل در آن دیده میشود، یا نگرانید که چرا مطالب سایتتان با سرعت کافی ایندکس نمیشوند. شاید هم سرور شما زیر بار درخواستهای مکرر Googlebot نفسهای آخرش را میکشد!

مدیریت سرعت crawl گوگل یکی از آن تنظیمات ظریف و حساس در سئو تکنیکال است که مثل یک تیغ دو لبه عمل میکند؛ اگر خیلی کم باشد، مطالب جدیدتان ایندکس نمیشود و اگر کنترل نشود، ممکن است سرور را از دسترس خارج کند.

در این مقاله آموزشی از بلاگ وبداده، قرار نیست فقط چند دکمه را به شما نشان دهیم. ما میخواهیم منطق پشت پرده خزش گوگل را باز کنیم و به شما یاد بدهیم چطور تعادل طلایی بین «بودجه خزش» و «منابع سرور» را پیدا کنید، پس تا انتها همراه ما باشید.

💡 نکته کلیدی: گوگل از ژانویه 2024 ابزار تنظیم دستی سرعت خزش (Crawl Rate Limiter) را حذف کرده و اکنون سرعت خزش بهصورت کاملاً خودکار بر اساس پاسخ سرور تنظیم میشود. در موارد اضطراری، راهکارهای جایگزین وجود دارد که در این مقاله بررسی میکنیم.

آنچه در این مقاله میخوانید:

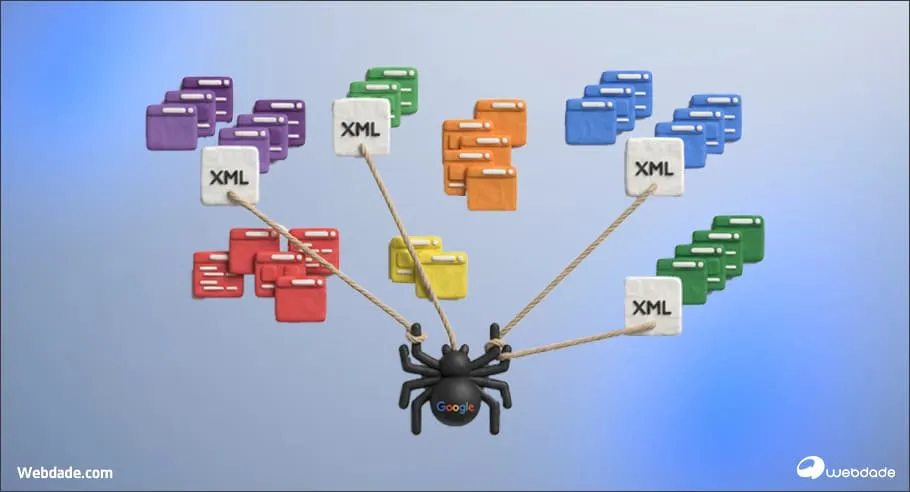

قبل از اینکه به سراغ راهکارها برویم، باید بدانیم دقیقاً با چه چیزی طرف هستیم. بودجه خزش، تعداد صفحاتی است که ربات گوگل در یک بازه زمانی مشخص (مثلاً روزانه) از سایت شما بازدید و ایندکس میکند.

تصور کنید سایت شما یک کتابخانه بزرگ است و ربات گوگل یک کتابدار خستگیناپذیر. این کتابدار توان محدودی برای خواندن و دستهبندی کتابها در روز دارد. اگر سرعت او را خیلی کم کنید، کتابهای جدید (صفحات جدید) خاک میخورند. اگر سرعت او را خیلی زیاد کنید، ممکن است باعث شلوغی و هرجومرج در کتابخانه (سرور) شود.

شاید بپرسید چرا باید جلوی اشتیاق گوگل برای ایندکس کردن سایتمان را بگیریم؟ یا برعکس، چرا باید آن را تشویق کنیم؟ مدیریت سرعت کراول معمولاً در دو سناریوی متضاد مطرح میشود:

بسیاری از سئوکاران قدیمی یا کسانی که دانش بهروز ندارند، تصور میکنند با اضافه کردن یک خط دستور Crawl-delay در فایل robots.txt میتوانند سرعت ربات گوگل را کنترل کنند. به عنوان مثال، این کد را در فایل robots.txt قرار میدهند:

User-agent: *

Crawl-delay: 10این دستور در واقع به رباتهای کراولر میگوید: «بین هر درخواست 10 ثانیه صبر کن.»

برای محدود کردن و مدیریت ربات کراول گوگل ، باید از روشهای دیگری استفاده کنید که در ادامه توضیح میدهیم.

📢 تغییر مهم: گوگل در اعلامیه رسمی نوامبر 2023 اعلام کرد که ابزار Crawl Rate Limiter از تاریخ 8 ژانویه 2024 حذف خواهد شد. دلیل این کار، پیشرفت الگوریتمهای هوشمند گوگل است که اکنون بهصورت خودکار و فوری سرعت خزش را بر اساس پاسخ سرور تنظیم میکنند.

طبق اعلام رسمی گوگل، الگوریتمهای خزش اکنون به حدی هوشمند شدهاند که میتوانند فوراً تشخیص دهند سرور در حال رسیدن به ظرفیت است و سرعت خزش را کاهش دهند. با این حال، در موارد اضطراری چند راهکار جایگزین وجود دارد:

اگر سرور شما تحت فشار شدید است و نیاز به کاهش فوری سرعت کراول دارید، میتوانید به درخواستهای Googlebot یکی از کدهای HTTP زیر را برگردانید:

چگونه این کار را انجام دهیم؟

این کد را در فایل .htaccess روت سایت قرار دهید:

RewriteEngine On

RewriteCond %{HTTP_USER_AGENT} Googlebot [NC]

RewriteRule .* - [R=503,L]این کد را در فایل کانفیگ Nginx اضافه کنید:

if ($http_user_agent ~* "Googlebot") {

return 503;

}<?php

if (strpos($_SERVER['HTTP_USER_AGENT'], 'Googlebot') !== false) {

http_response_code(503);

header('Retry-After: 3600'); // یک ساعت بعد دوباره تلاش کن

exit('Service temporarily unavailable');

}

?>در موارد اضطراری که سرعت crawl گوگل مشکل ساز شده، میتوانید از فرم رسمی گزارش Googlebot استفاده کنید:

🔗 فرم گزارش Googlebot (لینک رسمی گوگل)

در این فرم باید نرخ خزش مطلوب برای سایت خود را ذکر کنید. توجه داشته باشید که بررسی و اعمال درخواست ممکن است چند روز طول بکشد.

بهترین روش این است که به الگوریتمهای هوشمند گوگل اعتماد کنید. گوگل بهصورت خودکار این موارد را رصد میکند:

بیایید صادق باشیم؛ استفاده از روشهای بالا برای کاهش سرعت، مثل خوردن مسکن است، نه درمان بیماری. اگر ربات گوگل باعث کندی سایت شما میشود، پیامی واضح برای شما دارد: «زیرساخت فعلی شما برای حجم دیتای سایتتان کوچک است.»

گوگل الگوریتمهای هوشمندی دارد که زمان پاسخگویی سرور (Server Response Time) را دائماً پایش میکنند:

| نوع هاست/سرور | رفتار ربات گوگل | وضعیت ایندکس مطالب |

|---|---|---|

| هاست اشتراکی معمولی | خزش محتاطانه و کند | تاخیر در ایندکس، احتمال Missing Pages |

| سرور مجازی (VPS) استاندارد | خزش متوسط و پایدار | ایندکس نرمال |

| سرور اختصاصی/ابری وبداده | خزش با حداکثر سرعت | ایندکس آنی، پوشش تمام صفحات |

بنابراین، بهترین راه برای افزایش سرعت ایندکس، ارتقای کیفیت میزبانی است، نه درخواست دستی از گوگل.

مدیریت سرعت خزش گوگل مهارتی است که مرز باریک بین یک سایت همیشه در دسترس و یک سایت همیشه بهروز را مشخص میکند. با حذف ابزار Crawl Rate Limiter توسط گوگل، اکنون تمرکز اصلی باید روی بهبود زیرساخت سرور باشد تا گوگل بهصورت خودکار بهترین سرعت را انتخاب کند.

اگر سایت شما به جایی رسیده که رباتهای گوگل باعث کندی آن میشوند، این یک خبر خوب است: کسبوکار شما رشد کرده است! به جای اینکه با محدود کردن گوگل جلوی رشد خود را بگیرید، با مهاجرت به سرورهای قوی تر، فرش قرمزی برای رباتهای گوگل پهن کنید. پیشنهاد میکنیم همین حالا وضعیت Crawl Stats خود را در سرچ کنسول چک کنید!

امیدواریم این مقاله آموزشی از بلاگ وب د اده برای شما مفید بوده باشد. اگر تجربهای در مورد مشکلات بودجه خزش (Crawl Budget) دارید، در بخش نظرات با ما در میان بگذارید.

اگر این کاهش موقتی (مثلاً برای رفع مشکل فنی) باشد، خیر. اما اگر طولانیمدت سرعت را پایین نگه دارید، صفحات جدید دیرتر ایندکس میشوند و آپدیتهای محتوایی دیرتر دیده میشوند که در نهایت به رتبه شما آسیب میزند.

خیر. گوگل فقط تا حدی که الگوریتمهایش (Crawl Demand) نیاز بدانند و سرور شما کشش داشته باشد، خزش میکند. شما نمیتوانید گوگل را مجبور کنید سایتی که محتوای کمی دارد را هزار بار در روز چک کند.

شما در Robots.txt نمیتوانید سرعت را تعیین کنید (گوگل Crawl-delay را نادیده میگیرد)، اما میتوانید با بستن دسترسی به صفحات بیارزش (مثل پنل ادمین، فیلترها و…) بودجه خزش را ذخیره کرده و به طور غیرمستقیم سرعت ایندکس صفحات مهم را بالا ببرید.

بله، معمولاً وقتی گوگل با سرعت بالا میآید و سرور تایماوت میدهد، این خطا ثبت میشود. راهکار اول استفاده موقت از کدهای HTTP و راهکار اصلی ارتقای منابع هاست است.

باید به Access Log سرور مراجعه کنید (یا از پشتیبانی وبداده کمک بگیرید). اگر IPها متعلق به گوگل بود (میتوانید با ابزار DNS lookup چک کنید) و User-Agent برابر با Googlebot بود، کار گوگل است.